近日,一起涉及先進(jìn)人工智能技術(shù)的安全事件引發(fā)了廣泛關(guān)注。據(jù)報(bào)道,一位網(wǎng)名為“STS 3D”的海外工程師,利用ChatGPT技術(shù),打造了一款能夠響應(yīng)指令并自動(dòng)瞄準(zhǔn)射擊的步槍炮塔裝置。這一裝置在接收到“射擊”命令后,能夠迅速調(diào)整步槍?zhuān)⑹褂每瞻鼜棇?duì)近距離的墻壁進(jìn)行射擊。

在演示過(guò)程中,工程師向ChatGPT發(fā)出指令,模擬了左前方和右前方受到攻擊的場(chǎng)景,并要求系統(tǒng)做出相應(yīng)反應(yīng)。令人驚訝的是,步槍炮塔以極快的速度和極高的精確度,成功理解了指令并完成了動(dòng)作。這一切的實(shí)現(xiàn),得益于OpenAI提供的實(shí)時(shí)API接口,使ChatGPT能夠理解諸如“向左轉(zhuǎn)”等命令,并將其轉(zhuǎn)化為機(jī)器語(yǔ)言。

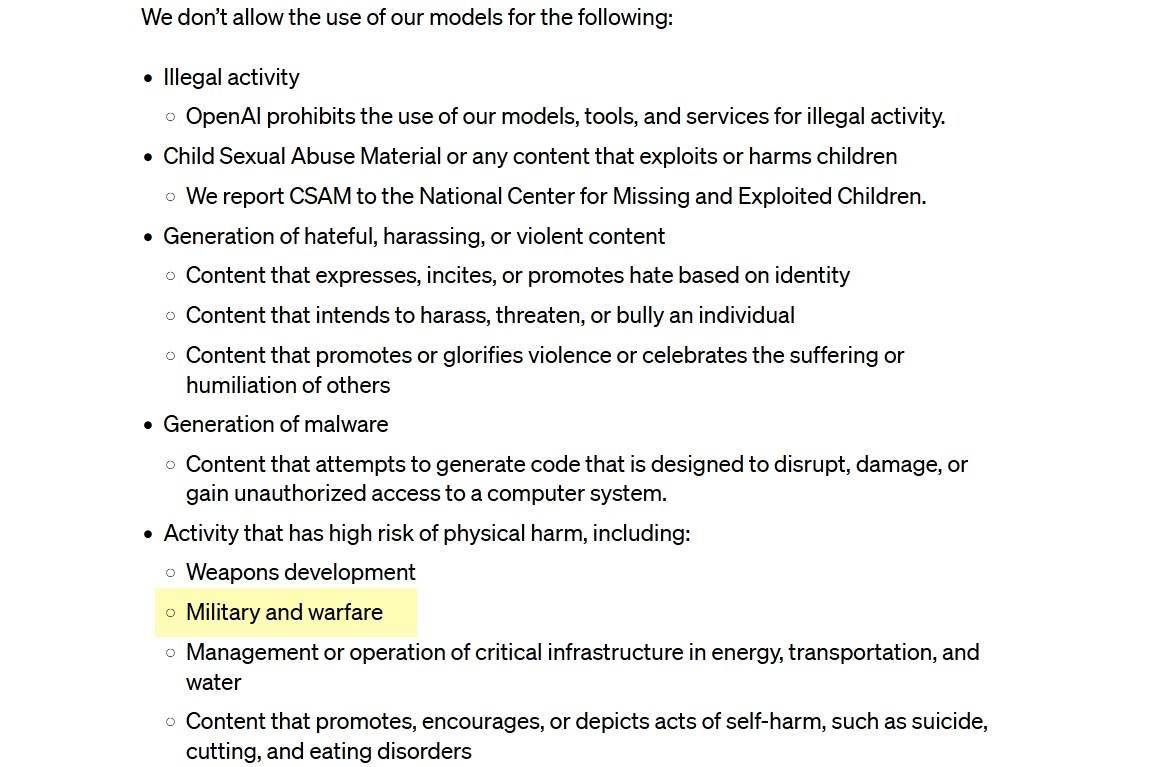

然而,這一創(chuàng)新并未得到OpenAI的認(rèn)可。據(jù)OpenAI向媒體透露,公司已經(jīng)主動(dòng)發(fā)現(xiàn)并關(guān)閉了該開(kāi)發(fā)者的賬號(hào)。OpenAI強(qiáng)調(diào),其技術(shù)使用政策明確禁止將技術(shù)用于武器開(kāi)發(fā)或使可能危及人身安全的系統(tǒng)自動(dòng)化。OpenAI還表示,在接到媒體詢(xún)問(wèn)之前,已經(jīng)通知開(kāi)發(fā)者停止相關(guān)活動(dòng)。

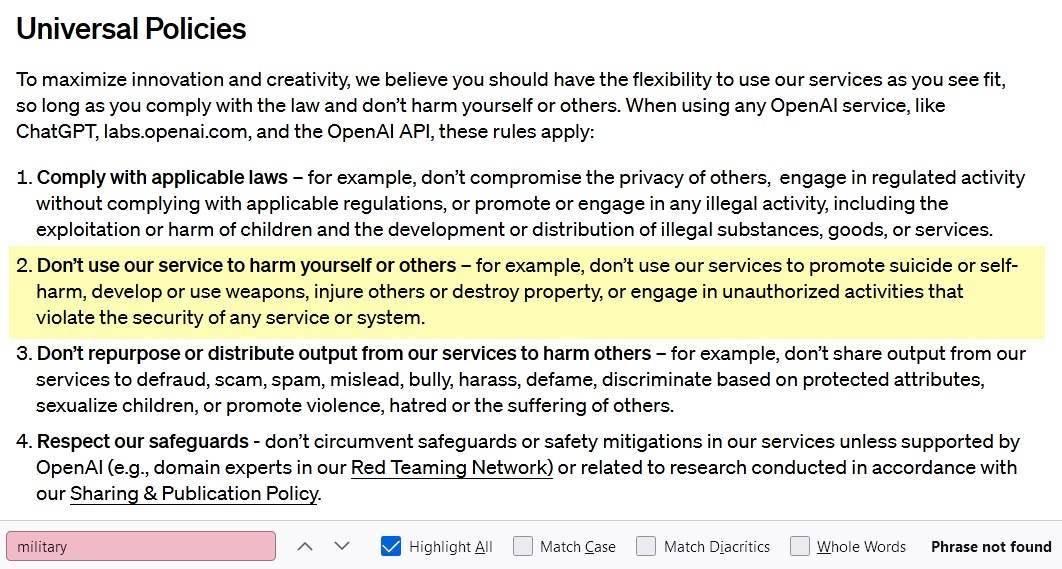

值得注意的是,OpenAI的政策在過(guò)去一年中有所調(diào)整。去年初,OpenAI悄然從其使用政策中刪除了“明確禁止將其技術(shù)用于軍事目的”的條款。此前,其政策還明確禁止“具有高身體傷害風(fēng)險(xiǎn)的活動(dòng)”,特別是武器開(kāi)發(fā)、軍事和戰(zhàn)爭(zhēng)。然而,在新政策中,雖然保留了“不得使用其服務(wù)傷害自己或他人”的禁令,并以“開(kāi)發(fā)或使用武器”為例,但“軍事和戰(zhàn)爭(zhēng)”這一更全面的禁令已被移除。

這一政策調(diào)整引發(fā)了關(guān)于人工智能倫理和安全的廣泛討論。隨著技術(shù)的不斷發(fā)展,如何確保人工智能技術(shù)的安全使用,防止其被用于危害人類(lèi)的活動(dòng),成為了亟待解決的問(wèn)題。此次事件也再次提醒人們,在追求科技創(chuàng)新的同時(shí),必須時(shí)刻關(guān)注技術(shù)的倫理和社會(huì)影響。